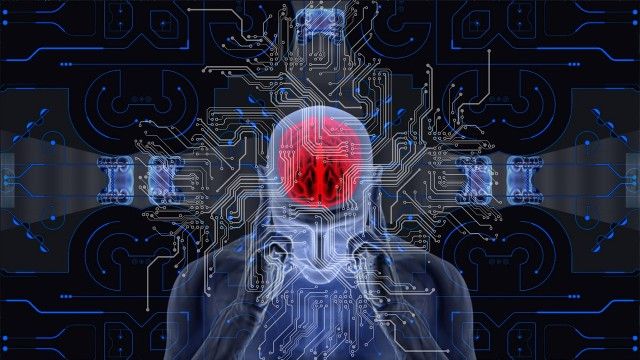

Sztuczna inteligencja (AI) staje się coraz bardziej obecna w naszym codziennym życiu. Wkracza w obszary zarezerwowane dla ludzkiego rozumowania, w tym etykę. Omawiając ten temat, warto przyjrzeć się jej potencjałowi i ograniczeniom. To kusząca perspektywa w erze, gdy dylematy etyczne stają się coraz bardziej złożone.

Zwolenicy AI podkreślają jej zdolność do analizy ogromnych ilości danych. Dzięki temu mogą lepiej podejść do problemów moralnych. Na przykład autonomiczne pojazdy muszą w sytuacjach kryzysowych podejmować błyskawiczne decyzje. Jak zminimalizować szkody w wypadkach? AI ocenia takie scenariusze, uwzględniając różne etyczne teorie, jak utylitaryzm czy deontologia.

Wyzwania związane z moralnym kompasem AI

Niemniej jednak nie możemy zapominać o istotnych obawach. Może zdarzyć się, że AI nie zrozumie kontekstu kulturowego i emocjonalnego. Algorytmy AI często uczą się na podstawie danych historycznych, które obarczone są uprzedzeniami. W rezultacie AI może powielać te wzorce społeczne, co prowadzi do ryzyka utrwalania nierówności.

W dodatku pojawia się pytanie o odpowiedzialność. Kto ponosi odpowiedzialność za decyzje podejmowane przez AI? Na przykład w medycynie, gdy AI decyduje o alokacji organów, ważne jest, aby te decyzje były sprawiedliwe. Musi uwzględniać specyfikę przypadków pacjentów. Ostatecznie odpowiedzialność pozostaje w gestii ludzi, którzy projektują algorytmy AI.

Kontekst etyki AI wymaga także edukacji i szkoleń z zakresu etycznego podejścia do rozwoju technologii. Twórcy oraz użytkownicy AI muszą rozumieć, jakie wartości etyczne są istotne. Zwiększona świadomość społeczna na temat możliwości i ograniczeń AI jest kluczowa. Pomaga w budowaniu zaufania do tych technologii oraz ich odpowiedzialnego stosowania.

Podsumowując, sztuczna inteligencja ma potencjał, aby wspierać podejmowanie decyzji w złożonych kwestiach etycznych. Nie może jednak zastąpić ludzkiego osądu. Współpraca między AI a ludźmi jest kluczowym podejściem do skutecznego rozwiązywania dylematów moralnych. AI powinna działać jako narzędzie wspierające, które wzmacnia, a nie zastępuje ludzki rozum. W przyszłości ważne będzie zapewnienie transparentności i odpowiedzialności za decyzje AI. To pozwoli w pełni wykorzystać jej potencjał w mądry i sprawiedliwy sposób.

Edukacja etyczna w erze AI: Jak przygotować przyszłe pokolenia?

Edukacja etyczna w erze sztucznej inteligencji (AI) staje się niezwykle ważnym tematem. Technologia ta wpływa na różne aspekty naszego życia. W miarę jak AI rozwija się, przygotowanie przyszłych pokoleń do współpracy z nią staje się kluczowe. Należy to robić w sposób odpowiedzialny i etyczny. Wprowadzenie etycznych zasad w nauczaniu ma na celu wyposażenie młodych ludzi w umiejętności krytycznego myślenia.

Jednym z kluczowych aspektów edukacji etycznej jest zrozumienie, jak AI może wspierać ludzki osąd. Może ona również zagrażać tym osądom. Sztuczna inteligencja ukazuje obiektywne spojrzenie na dylematy moralne. Jednakże sektor ten stoi przed wyzwaniami związanymi z uproszczeniem skomplikowanych kontekstów kulturowych i emocjonalnych. Dlatego przyszłe pokolenia muszą nauczyć się, jak łączyć możliwości technologii z ludzkim osądem.

Rola krytycznego myślenia i refleksji

W edukacji etycznej ważnym elementem jest rozwijanie umiejętności krytycznego myślenia. Również refleksji na temat skutków decyzji podejmowanych przy wsparciu AI. Przyszli użytkownicy technologii powinni zadawać pytania o to, jakie wartości etyczne leżą u podstaw algorytmów. Szkoły oraz uczelnie powinny wprowadzać programy, które łączą nauki o technologiach z etyką, filozofią i socjologią.

Ważne jest, aby uczniowie zrozumieli wyzwania etyczne związane z używaniem AI. Obejmuje to kwestie prywatności, bezpieczeństwa danych oraz potencjalnych uprzedzeń w algorytmach. Edukacja powinna akcentować, że technologia sama w sobie nie jest neutralna. Jej zastosowanie wiąże się również z odpowiedzialnością moralną.

Praktyczne zastosowanie wiedzy etycznej

W czasie nauki kluczowe jest stworzenie przestrzeni dla uczniów. Powinni oni mieć możliwość testowania teoretycznej wiedzy w praktyce. Symulacje rzeczywistych scenariuszy moralnych mogą być pomocne. Współpraca nad projektami AI oraz analizowanie faktycznych przypadków znacząco wzbogacą proces kształcenia.

Podsumowując, edukacja etyczna w erze AI jest kluczowa. Przyszłe pokolenia muszą stawić czoła wyzwaniom, jakie niesie rozwój technologii. Rozwijając umiejętności krytycznego myślenia oraz refleksji nad wartościami, możemy przygotować młodych ludzi do korzystania z AI. Taki sposób działania powinien być zgodny z etyką i odpowiedzialnością społeczną.

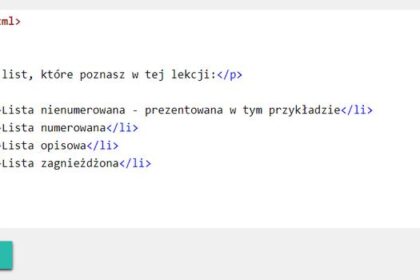

- Kwestie prywatności danych

- Bezpieczeństwo danych

- Potencjalne uprzedzenia w algorytmach

Na liście przedstawione są kluczowe wyzwania etyczne związane z używaniem sztucznej inteligencji, które uczniowie powinni zrozumieć i analizować.

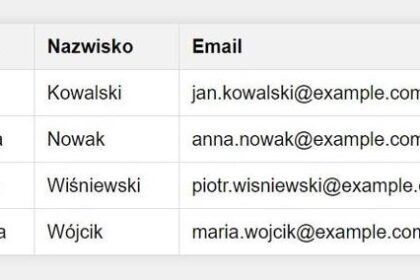

| Temat | Opis |

|---|---|

| Edukacja etyczna w erze AI | Przygotowanie przyszłych pokoleń do współpracy z AI w sposób odpowiedzialny i etyczny. |

| Etyczne zasady w nauczaniu | Wzbogacenie młodych ludzi w umiejętności krytycznego myślenia. |

| Wsparcie ludzkiego osądu | Zrozumienie, jak AI może wspierać lub zagrażać ludzkiemu osądowi. |

| Rola krytycznego myślenia | Rozw development umiejętności krytycznego myślenia i refleksji na temat skutków decyzji przy wsparciu AI. |

| Wyzwania etyczne | Kwestie prywatności, bezpieczeństwa danych oraz uprzedzeń w algorytmach. |

| Praktyczne zastosowanie wiedzy etycznej | Tworzenie przestrzeni do testowania teoretycznej wiedzy w praktyce poprzez symulacje i projekty AI. |

| Kluczowe wyzwania etyczne |

|

Ciekawostką jest, że według badania przeprowadzonego przez Stanford University, tylko 30% nauczycieli w USA czuje się pewnie w nauczaniu tematyki związanej z etyką sztucznej inteligencji.

Przykłady zastosowania AI w podejmowaniu decyzji etycznych w biznesie

Sztuczna inteligencja (AI) zdobywa coraz większe uznanie w podejmowaniu decyzji etycznych w biznesie. To otwiera nowe możliwości, ale stawia także istotne wyzwania. Przykłady zastosowania AI pokazują, jak technologia może wspierać trudne moralne decyzje w różnych dziedzinach życia. Warto rozważyć konkretne sytuacje, w których wykorzystuje się AI w aspekcie etycznym oraz potencjalne korzyści i zagrożenia z tym związane.

Jednym z kluczowych obszarów z wpływem AI na etykę jest medycyna. Systemy AI pomagają w alokacji organów do przeszczepów, co wiąże się z trudnymi wyborami. Algorytmy analizują czynniki, na przykład wiek, stan zdrowia czy socjalne tło pacjentów. Dzięki temu AI może wspierać decyzje bardziej obiektywnie.

Zastosowanie AI w branży finansowej i prawnej

Branża finansowa to kolejny przykład wykorzystania AI w etyce podejmowania decyzji. AI pomaga w identyfikowaniu nadużyć oraz w podejmowaniu decyzji o kredytach. Dzięki AI można eliminować uprzedzenia związane z rasą, płcią czy pochodzeniem etnicznym. W obszarze sprawiedliwości karnej, AI wspiera sędziów w ocenie ryzyka recydywy. Tego rodzaju rozwiązania mogą znacząco zwiększyć efektywność procesów decyzyjnych.

Zastosowanie AI w decyzjach etycznych stawia przed nami licznie wyzwania. Jednym z podstawowych problemów jest transparentność algorytmów. Często działają one jak „czarne skrzynki”, co wpływa na nasze zaufanie do ich decyzji. Także mistrzostwo AI w analizie danych sprawia, że algorytmy mogą powielać istniejące uprzedzenia.

Kolejnym istotnym elementem jest współpraca ludzi z AI w kontekście etyki. Choć AI skutecznie analizuje dane i proponuje rozwiązania, ludzka intuicja oraz zdolność rozumienia kontekstu społecznego pozostają niezastąpione. Ostatecznie to człowiek powinien podejmować decyzje o etycznych aspektach sytuacji. AI ma wspierać ten proces, ale nie zastąpić ludzkiego wglądu.

Na zakończenie, rozwój AI w kontekście podejmowania decyzji etycznych to złożona kwestia. Wymaga on ciągłego dialogu między technologią a człowiekiem. Konieczne staje się też wdrażanie regulacji oraz skutecznych strategii edukacyjnych. To pozwoli na odpowiedzialne i sprawiedliwe wykorzystanie AI w tym obszarze.

Rola społeczności w kształtowaniu norm moralnych dla technologii XXI wieku

W XXI wieku technologia zdominowała nasze życie. Jej dynamiczny rozwój przynosi istotne wyzwania etyczne, które musimy rozwiązać. Sztuczna inteligencja (AI) nabiera znaczenia w wielu dziedzinach. Dlatego normy moralne dotyczące jej zastosowania stają się kluczowe.

W miarę wkraczania AI w medycynę, prawo i edukację, musimy wypracować zasady etyczne. Zasady te będą kierować użyciem sztucznej inteligencji. Społeczności lokalne i globalne mogą aktywnie uczestniczyć w tych dyskusjach. Dodatkowo, mogą wnosić cenne perspektywy, a także domagać się odpowiedzialnych praktyk. Ochrona prywatności, przejrzystość algorytmów i eliminacja uprzedzeń to ważne kwestie.

Rola społeczności w kształtowaniu norm etycznych

Współczesne społeczeństwa są zróżnicowane, co wpływa na nasze wartości i oczekiwania wobec technologii. Włączenie społeczności w tworzenie norm moralnych dla AI prowadzi do lepszych rozwiązań. Przykładem jest zastosowanie AI w rekrutacji. Algorytmy muszą być zaprojektowane tak, aby eliminować uprzedzenia płciowe oraz etniczne. Dialog z zainteresowanymi stronami pomoże zrozumieć kluczowe wartości, jakie można wkomponować w technologię.

W medycynie, wykorzystanie AI przy alokacji organów do przeszczepu wymaga uwzględnienia aspektów etycznych. Wszyscy zainteresowani, w tym pacjenci, lekarze i etycy, powinni mieć możliwość wypowiedzenia się. Tylko tak zbudujemy zaufanie do systemów AI, które wpływają na życie ludzi.

Aby społeczności mogły skutecznie kształtować normy moralne, potrzebna jest edukacja. Działania na rzecz podnoszenia świadomości o możliwościach oraz ograniczeniach AI są niezbędne. Szkolenie ludzi w zakresie etyki AI i prowadzenie debat publicznych to kroki w stronę odpowiedzialnych technologii.

Na koniec, technologia sama nie rozwiąże problemów etycznych związanych z AI. To my, jako społeczność, musimy podejmować działania. Krytyczne decyzje są naszą odpowiedzialnością. Dbanie o to, by rozwój technologii odzwierciedlał wartości moralne, jest kluczowe. W skład tego procesu wchodzą liderzy, organizacje pozarządowe, edukatorzy oraz obywatele.

- Liderzy – mają kluczową rolę w podejmowaniu decyzji i wdrażaniu odpowiednich praktyk.

- Organizacje pozarządowe – mogą wspierać inicjatywy etyczne i informować o problemach związanych z AI.

- Edukatorzy – są odpowiedzialni za kształcenie przyszłych pokoleń w zakresie etyki AI.

- Obywatele – powinni aktywnie uczestniczyć w debatach dotyczących zastosowania technologii.

Wszystkie te grupy są kluczowe dla kształtowania etycznych ram dla sztucznej inteligencji i technologii.

Wyzwania związane z zaufaniem do systemów opartych na sztucznej inteligencji

Sztuczna inteligencja (AI) zyskuje na znaczeniu w wielu aspektach życia. Jednak rozwój AI wiąże się z wyzwaniami etycznymi. Chodzi tu o zaufanie do systemów, które podejmują istotne decyzje. W miarę jak AI staje się bardziej złożona, rośnie liczba pytań o odpowiedzialność, bezstronność oraz przejrzystość.

Jednym z kluczowych problemów, z jakimi borykają się twórcy AI, są algorytmiczne uprzedzenia. AI uczy się na podstawie danych, które mogą zawierać istniejące w społeczeństwie uprzedzenia. Bez odpowiednich mechanizmów bezpieczeństwa AI może powielać, a nawet pogłębiać istniejące nierówności.

Przejrzystość i odpowiedzialność jako fundamenty zaufania

Przejrzystość algorytmów AI jest kluczowa w budowaniu zaufania. Użytkownicy muszą zrozumieć, jak systemy podejmują decyzje. W przeciwnym razie, trudniej będzie przypisać odpowiedzialność za błędy.

Warto zauważyć, że odpowiedzialność za decyzje AI nie jest prosta do określenia. Kto ponosi konsekwencje za błędy algorytmu? To zagadnienie wymaga stworzenia jasnych ram regulacyjnych. Ponadto, określą one odpowiedzialność i działania w sytuacjach krytycznych. Budując zaufanie, należy również pamiętać, że AI nie jest neutralnym narzędziem.

Ochrona prywatności stanowi kolejne istotne wyzwanie w etyce AI. Sztuczna inteligencja przetwarza ogromne ilości danych osobowych. To budzi obawy związane z ich bezpieczeństwem. Musimy zapewnić użytkownikom zrozumienie, jak ich dane są wykorzystywane, a także jakie mają prawa.

Podsumowując, wyzwania związane z zaufaniem do systemów AI są złożone. Kluczowe jest połączenie technologii z odpowiedzialnością, przejrzystością oraz zasadami etycznymi. Współpraca ekspertów z różnych dziedzin, w tym technologii, etyki i prawa, przyniesie korzyści. Edukacja i ciągłe doskonalenie technologii są niezbędne, by sprostać oczekiwaniom społeczeństwa.

Podsumowanie

- Sztuczna inteligencja (AI) staje się ważnym narzędziem w podejmowaniu decyzji etycznych, ale nie może zastąpić ludzkiego osądu.

- AI ma potencjał do analizy danych i oceny różnych etycznych teorii, co pomaga w rozwiązaniu skomplikowanych dylematów moralnych.

- Ograniczenia AI obejmują brak zrozumienia kontekstu kulturowego i emocjonalnego oraz ryzyko powielania istniejących uprzedzeń.

- Odpowiedzialność za decyzje podejmowane przez AI leży po stronie ludzi, którzy projektują algorytmy.

- Edukacja etyczna w zakresie AI jest kluczowa dla przyszłych pokoleń, aby mogły współpracować z technologią w sposób odpowiedzialny.

- Krytyczne myślenie oraz przestrzeń do praktycznego zastosowania wiedzy etycznej są niezbędne w edukacji.

- Współpraca między ludźmi a AI jest kluczowa w efektywnym podejmowaniu decyzji i budowaniu zaufania do technologii.

- Transparentność algorytmów oraz ochrona prywatności danych są fundamentalnymi wyzwaniami związanymi z zaufaniem do AI.

- Aktywny udział społeczności w tworzeniu norm etycznych dla AI jest niezbędny do odpowiedzialnego wykorzystania technologii.

Źródła:

- https://poradnikiosx.pl/jak-sztuczna-inteligencja-rozwiazuje-dylematy-etyczne-fakty-i-mity

- https://www.exaity.pl/jak-sztuczna-inteligencja-moze-rozwiazac-dylematy-etyczne/

- https://przemyslprzyszlosci.gov.pl/etyka-w-sztucznej-inteligencji-jak-zapewnic-ze-ai-bedzie-sluzyc-dobru-ludzkosci/

- https://promptowy.com/etyczne-aspekty-sztucznej-inteligencji-wyzwania-i-rozwiazania/

- https://www.aimarketing.pl/etyka-w-sztucznej-inteligencji-wyzwania-i-rozwiazania/

- https://future-code.dev/blog/etyczne-dylematy-sztucznej-inteligencji-w-rozwoju-oprogramowania/

- https://pl.polarysgroup.eu/insights/kwestie-etyczne-dotyczace-gen-ai/

- https://web.swps.pl/strefa-psyche/blog/relacje/22399-etyczna-sztuczna-inteligencja-czy-etyke-mozna-zaprogramowac