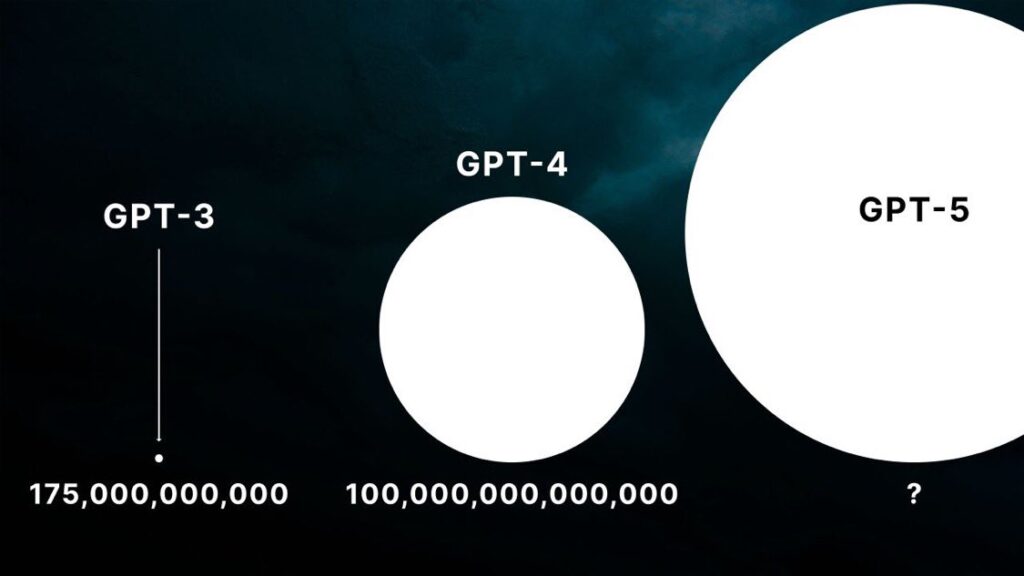

Sztuczna inteligencja (SI) oraz ludzkie myślenie różnią się w wielu fundamentalnych aspektach. Na przykład, takie technologie jak ChatGPT zaprojektowano w celu symulacji funkcji poznawczych, takich jak rozumienie języka, rozwiązywanie problemów oraz generowanie tekstu. W przeciwieństwie do tego, ludzie myślą w oparciu o emocje, intuicję i osobiste doświadczenia, co czyni ich procesy myślowe znacznie bardziej złożonymi i wieloaspektowymi.

Sztuczna inteligencja, a zwłaszcza systemy oparte na modelach językowych, operują w oparciu o ogromne zbiory danych oraz algorytmy, które pozwalają przewidywać odpowiedzi na podstawie dostarczonych informacji. Ludzie natomiast przetwarzają informacje, uwzględniając emocje oraz kontekst społeczny. Takie podejście pozwala im podejmować decyzje w sposób bardziej elastyczny i złożony.

Różnice w nauce i uczeniu się

W przypadku sztucznej inteligencji uczenie się polega głównie na analizie danych i identyfikacji wzorców. ChatGPT, jako przykładowy system, może generować teksty oraz odpowiadać na pytania, jednak nie „rozumie” tych informacji w tradycyjnym sensie. W rzeczywistości, działa bardziej jak zaawansowany kalkulator przetwarzający dane, a nie jako człowiek, który integruje wiedzę z praktycznymi doświadczeniami.

Co więcej, ludzkie myślenie wyróżnia się zdolnością do kreatywnego rozwiązywania problemów, co łączy się z emocjami i osobistymi przekonaniami. Ludzie podejmują decyzje bazując na intuicji oraz kontekście społecznym, a to umożliwia im adaptację do zmieniających się sytuacji. Z kolei sztuczna inteligencja, pomimo efektywności w analizie danych, często napotyka trudności związane z brakiem elastyczności w nietypowych sytuacjach.

Kiedy korzystamy z AI, na przykład ChatGPT, warto, aby użytkownicy zrozumieli ograniczenia takich technologii. Narzędzia te nie są w stanie zastąpić ludzkiego myślenia, zwłaszcza w sytuacjach wymagających kreatywności, empatii czy zrozumienia złożonych relacji międzyludzkich. Dlatego też, należy podchodzić do danych generowanych przez AI z krytycznym myśleniem oraz weryfikować ich rzetelność.

Z jakimi wyzwaniami boryka się ChatGPT w codziennym użyciu?

ChatGPT, jako zaawansowane narzędzie sztucznej inteligencji, staje wobec wielu wyzwań, z jakimi zmaga się w codziennym użytkowaniu. Mimo imponujących możliwości generowania tekstu i prowadzenia konwersacji, które użytkownicy rzeczywiście doświadczają, model ten napotyka ograniczenia wpływające na jego efektywność oraz dokładność.

Ograniczenia w dostępie do informacji

Przede wszystkim, ChatGPT zmaga się z brakiem dostępu do aktualnych informacji. Choć model wytrenuje się na obszernych zbiorach danych, jego wiedza obejmuje jedynie okres do października 2021 roku. W rezultacie brak aktualnych danych sprawia, że zdarza mu się podawać nieadekwatne lub niepełne odpowiedzi, co w wielu przypadkach prowadzi do dezinformacji.

- Brak dostępu do aktualnych informacji

- Wiedza ograniczona do października 2021 roku

- Brak rozwiązań do weryfikacji faktów w czasie rzeczywistym

- Nieprawdziwe lub fikcyjne informacje nazywane „halucynacjami”

Warto także zauważyć, iż model nie dysponuje rozwiązaniami do weryfikacji faktów w czasie rzeczywistym. Taka sytuacja dodatkowo ogranicza jego zdolność do dostarczania precyzyjnych informacji. W związku z tym, użytkownicy powinni być świadomi, że nie wszystko, co generuje ten model, można traktować jako pewne i wiarygodne.

Trudności w zrozumieniu kontekstu

Choć ChatGPT dobrze generuje spójne odpowiedzi, jego zrozumienie kontekstu różni się od ludzkiego podejścia. Brak umiejętności głębszej analizy sytuacji prowadzi do tego, że w przypadku skomplikowanych pytań, model nie zawsze odpowiada adekwatnie lub precyzyjnie. Ograniczenia te mogą szczególnie przeszkadzać w zastosowaniach wymagających specjalistycznej wiedzy, gdzie błędne informacje mogą prowadzić do poważnych konsekwencji.

Kolejnym istotnym aspektem jest to, że ChatGPT łatwo dostosowuje się do sugestywnych pytań. Takie zachowanie skutkuje generowaniem odpowiedzi zgodnych z oczekiwaniami użytkownika, nawet jeśli są one błędne. Manipulacja pytaniami oraz odpowiedziami stawia przed użytkownikami nowe wyzwanie – potrzebę krytycznego myślenia i weryfikacji informacji nawet przed ich zastosowaniem.

Bezpieczeństwo i prywatność

W kontekście korzystania z ChatGPT, równie istotne staje się zagadnienie bezpieczeństwa danych. Model uczy się na podstawie interakcji z użytkownikami, co rodzi pytania dotyczące ochrony prywatności. Potencjalne przechowywanie danych wprowadzonych przez użytkowników niesie za sobą ryzyko nadużyć oraz naruszenia prywatności. W związku z tym, użytkownicy powinni unikać podawania wrażliwych informacji podczas korzystania z narzędzia.

- Bezpieczeństwo danych użytkowników

- Ochrona prywatności

- Ryzyko nadużyć

- Unikanie podawania wrażliwych informacji

Podsumowując, te wszystkie wyzwania wskazują na to, że mimo rosnącej popularności ChatGPT, użytkownicy muszą podchodzić do stosowania tej technologii z rozwagą. Ostatecznie, choć ten model ma ogromny potencjał, nie stanowi doskonałego narzędzia i wymaga krytycznego oraz świadomego podejścia w jego użyciu.

| Kategoria | Wyzwania |

|---|---|

| Ograniczenia w dostępie do informacji |

|

| Trudności w zrozumieniu kontekstu |

|

| Bezpieczeństwo i prywatność |

|

Jakie są ograniczenia technologii tworzenia języka naturalnego?

Technologia tworzenia języka naturalnego, mimo swojego rewolucyjnego charakteru, posiada pewne ograniczenia. ChatGPT, jako jeden z przykładów tego systemu, wykorzystuje zaawansowane algorytmy do generowania tekstu, ale mimo tego nie potrafi w pełni zrozumieć kontekstu tak, jak robi to człowiek. Jego działanie opiera się na danych, które posłużyły do treningu, co ma wpływ na jakość oraz trafność generowanych odpowiedzi.

Pierwsze poważne ograniczenie dotyczące tej technologii związane jest z brakiem dostępu do bieżących informacji. ChatGPT synchronizuje swoje zasoby w oparciu o materiały sprzed określonego momentu, co uniemożliwia udzielanie aktualnych odpowiedzi na szybko zmieniające się pytania, takie jak wiadomości czy wydarzenia. Skutkiem tego może być dezinformacja oraz rozczarowanie użytkowników, którzy liczą na rzetelną i aktualną wiedzę.

Ograniczenia w rozumieniu kontekstu oraz generowaniu poprawnych odpowiedzi

Warto także zauważyć, że ChatGPT nie dysponuje zdolnością prawdziwego rozumienia kontekstu. Choć tworzy spójne i logiczne wypowiedzi, to czasami jego odpowiedzi okazują się nieadekwatne, zwłaszcza w przypadkach wymagających zaawansowanej wiedzy specjalistycznej. Dodatkowo, model nie wykazuje wrażliwości na emocje ani empatii, co znacznie ogranicza jego zdolność do angażowania się w bardziej złożone interakcje społeczne.

Niestety, technologia ta narażona jest również na tzw. „halucynacje”, co oznacza, że może generować nieistniejące lub fałszywe informacje. Takie sytuacje mogą wprowadzać użytkowników w błąd, a konsekwencje mogą być szczególnie niebezpieczne w dziedzinach takich jak badania, medycyna czy prawo, gdzie precyzja i zgodność z rzeczywistością są kluczowe.

Nie należy także pomijać etycznych aspektów korzystania z ChatGPT. Ponieważ model generuje teksty na podstawie danych pochodzących z internetu, istnieje ryzyko reprodukowania nieodpowiednich lub kontrowersyjnych treści. Na przykład, w wyniku działania tej technologii mogą pojawiać się nieetyczne lub obraźliwe odpowiedzi, co rodzi pytania dotyczące odpowiedzialności twórców takich narzędzi.

Podsumowując, chociaż technologia tworzenia języka naturalnego dysponuje ogromnym potencjałem, wciąż wymaga intensywnej pracy nad swoimi ograniczeniami. Użytkownicy powinni być świadomi tych istotnych wad, aby korzystając z narzędzi takich jak ChatGPT, robić to w sposób efektywny i odpowiedzialny.

Analiza przypadków wykorzystania ChatGPT w różnych branżach

ChatGPT to narzędzie sztucznej inteligencji, które zdobyło popularność w różnych sektorach dzięki umiejętności generowania tekstu oraz prowadzenia interaktywnych rozmów. Oparty na architekturze GPT (Generative Pre-trained Transformer), model ten potrafi analizować i przetwarzać naturalny język, co czyni go wszechstronnym w takich branżach jak:

- edukacja

- marketing

- obsługa klienta

W kontekście edukacji, ChatGPT pełni rolę wirtualnego asystenta, wspierając uczniów w nauce oraz odrabianiu prac domowych. Uczniowie korzystają z tego narzędzia, aby:

- lepiej zrozumieć skomplikowane zagadnienia

- tłumaczyć teksty

- generować zestawy testów

Nauczyciele mają możliwość wykorzystywania ChatGPT do tworzenia interaktywnych lekcji oraz komunikacji z uczniami, co znacznie wzbogaca proces edukacyjny.

Zastosowanie ChatGPT w biznesie

W obszarze biznesowym, ChatGPT zdobył uznanie jako narzędzie do automatyzacji zadań i poprawy efektywności. Wiele firm korzysta z niego do:

- generowania treści marketingowych

- obsługi klienta poprzez chatboty

- analizy danych

Dzięki możliwości działania przez całą dobę, ChatGPT wspiera pracowników, wykonując rutynowe zadania, co pozwala im skupić się na bardziej złożonych projektach.

W branży IT, programiści używają ChatGPT jako narzędzia do kodowania oraz debugowania. Model ten potrafi pomóc w:

- pisaniu skryptów

- udzielaniu wskazówek dotyczących programowania

Co więcej, jego umiejętność generowania prostych kodów sprawia, że staje się cennym wsparciem dla początkujących programistów.

Jednak pomimo licznych zalet, ChatGPT posiada swoje ograniczenia. Jego odpowiedzi mogą okazać się niepełne lub nieprawdziwe, szczególnie gdy chodzi o aktualne informacje. Model ten nie rozumie kontekstu tak, jak człowiek, co czasami prowadzi do błędnych interpretacji i generowania nieodpowiednich treści.

Z tego powodu kluczowe jest, aby użytkownicy podchodzili do ChatGPT z krytycznym umysłem, weryfikując jego odpowiedzi.

Podsumowując, ChatGPT wprowadza innowacje w wielu dziedzinach, łącząc zalety technologii z ludzkim zrozumieniem. Jego wszechstronność oraz elastyczność sprawiają, że może być wykorzystywany w szerokim zakresie zastosowań, od edukacji po biznes. Niemniej jednak, z jego możliwościami związane są wyzwania, których świadomość pomoże w pełnym wykorzystaniu potencjału tej technologii.

Przyszłość sztucznej inteligencji: czy ChatGPT może stać się bardziej samoświadomy?

Przyszłość sztucznej inteligencji intryguje nie tylko ekspertów, ale również przeciętnych użytkowników technologii. ChatGPT, będąc jednym z najgłośniejszych przedstawicieli AI, zyskuje na popularności. Zadajmy pytanie: czy to narzędzie może kiedykolwiek stać się samoświadome? Owszem, generuje teksty i prowadzi rozmowy, jednak brakuje mu emocji oraz prawdziwej świadomości.

Model językowy, na którym bazuje ChatGPT, pozwala mu rozumieć kontekst, co z kolei umożliwia generowanie odpowiedzi. Wiele z nich wydaje się naturalnych. Niemniej jednak, warto zauważyć, że działania ChatGPT opierają się na przewidywaniu kolejnych słów w zdaniach. W rezultacie, model nie rozumie otaczającego go świata w prawdziwym sensie. To zjawisko sprawia, że mimo imponujących zdolności, nie potrafi dokonywać refleksji ani oceniać moralnych aspektów.

Możliwości i ograniczenia AI

Technologia AI, w tym ChatGPT, ma ogromny potencjał w różnych dziedzinach, takich jak edukacja, biznes czy rozrywka. Jednakże, jej ograniczenia nie pozostają bez znaczenia. Wiele osób zastanawia się, jak wpływają na nasze życie i pracę rozwijające się narzędzia. Przy odpowiednim zastosowaniu, ChatGPT służy do automatyzacji zadań, wspiera procesy edukacyjne oraz generuje kreatywne treści. Należy jednak zawsze równoważyć te korzyści krytycznym podejściem do generowanych informacji.

Ryzyko dezinformacji staje się jednym z poważniejszych wyzwań. Warto pamiętać, że ChatGPT operuje na danych sprzed października 2021 roku, co oznacza, iż nie ma dostępu do najnowszych informacji. Taka sytuacja może prowadzić do podawania nieaktualnych lub nieznanych danych. W kontekście bardziej złożonych zadań model może również popełniać błędy, co wymaga od użytkowników weryfikacji informacji oraz ostrożności w podejmowaniu decyzji.

Przyszłość sztucznej inteligencji, w tym ChatGPT, jawi się obiecująco, ale jednocześnie nie bez kontrowersji. W miarę jak technologia postępuje, pojawiają się pytania dotyczące etyki, odpowiedzialności oraz potencjalnych zagrożeń związanych z jej wykorzystaniem. Niezależnie od wszystkiego, to narzędzie ilustruje, jak blisko jesteśmy do stworzenia modeli, które symulują ludzki sposób myślenia. Niemniej jednak, na pewno nie zastąpią one pełnej świadomości ani emocji, jakie posiada człowiek.

Podsumowanie

- Sztuczna inteligencja różni się od ludzkiej myśli, operując na danych i algorytmach, a nie emocjach i osobistych doświadczeniach.

- ChatGPT działa jako zaawansowany kalkulator przetwarzający informacje, ale nie rozumie ich w tradycyjnym sensie.

- System ten ma ograniczenia w dostępie do aktualnych informacji oraz nie potrafi weryfikować faktów w czasie rzeczywistym.

- Słabości w zrozumieniu kontekstu mogą prowadzić do generowania błędnych lub nieadekwatnych odpowiedzi.

- Bezpieczeństwo danych użytkowników oraz prywatność są istotnymi kwestiami podczas użytkowania ChatGPT.

- Technologia AI, mimo swoich możliwości, wymaga krytycznego podejścia ze strony użytkowników.

- ChatGPT znajduje zastosowanie w wielu branżach, takich jak edukacja, marketing i obsługa klienta.

- Rozwój technologii AI wiąże się z pytaniami o etykę, odpowiedzialność i potencjalne zagrożenia.

Źródła:

- https://itpedia.pl/czy-chatgpt-to-sztuczna-inteligencja-jak-dziala-i-jakie-ma-ograniczenia

- https://drbresearch.pl/czy-chatgpt-to-sztuczna-inteligencja-wyjasniamy-jak-dziala-i-co-warto-wiedziec

- https://grzegorzczekala.pl/calmedu/artykuly/czym-jest-chatgpt/

- https://coderslab.pl/pl/blog/czy-chat-gpt-jest-w-stanie-zastapic-czlowieka

- https://giznet.pl/chat-gpt-jak-wlaczyc-jak-dziala-sztuczna-inteligencja/