Rozwój sztucznej inteligencji (SI) przynosi wiele korzyści oraz wyzwań związanych z cyberzagrożeniami. Wraz z gromadzeniem danych osobowych, ochrona prywatności staje się kluczowa. Dlatego wprowadzamy regulacje oraz praktyki, które zapewnią bezpieczeństwo danych przed nieuprawnionym dostępem.

Ochrona danych w erze algorytmów to wyzwanie nie tylko dla instytucji, ale także dla użytkowników. Użytkownicy powinni unikać przekazywania wrażliwych danych, takich jak numery PESEL, aplikacjom bez odpowiednich zabezpieczeń.

Regulacje prawne a kwestia ochrony danych

W odpowiedzi na obawy dotyczące bezpieczeństwa danych, Unia Europejska wprowadza regulacje, takie jak Akt o Sztucznej Inteligencji. Te przepisy mają zabezpieczyć użytkowników przed nadużyciami. Jasne zasady odpowiedzialności za działania algorytmów są niezbędne, aby budować zaufanie do technologii.

Jednym z zagrożeń związanych z SI jest tzw. „efekt czarnej skrzynki”. Taki brak przejrzystości może doprowadzić do sytuacji, w których osoby dotknięte skutkami decyzji nie wiedzą, jak się odwołać. Wyjaśnienie zasad działania SI oraz edukacja w tym zakresie stają się kluczowe.

Potencjalnie niebezpieczne zastosowania SI, jak generowanie fałszywych treści czy deepfake, stawiają nowe wyzwania dla regulacji prawnych. Odpowiedzialność za ich wykorzystanie również wymaga uregulowania. W kontekście demokracji, takie regulacje pomogą ograniczyć wpływ dezinformacji.

Wnioskując, zrównoważony rozwój sztucznej inteligencji wymaga odpowiedzialności od twórców technologii i użytkowników. Kluczowa jest współpraca międzysektorowa, która pozwoli wykorzystać potencjał AI. Wzmacniając regulacje i promując edukację na temat SI, możemy wspierać rozwój innowacji przy jednoczesnym minimalizowaniu ryzyk związanych z jej zastosowaniem.

Przyszłość pracy: Jak sztuczna inteligencja zmienia rynek zatrudnienia?

Przyszłość pracy w erze sztucznej inteligencji (SI) staje się coraz bardziej złożona i dynamiczna. Technologie oparte na SI wprowadzają znaczące zmiany w naszych obowiązkach zawodowych. Automatyzacja rutynowych zadań, takich jak obsługa klienta oraz przetwarzanie danych, zmienia tradycyjne role. To może prowadzić do istotnych przekształceń na rynku pracy.

Obawy o bezrobocie technologiczne stają się coraz bardziej realne. Szacuje się, że automatyzacja wyeliminuje wiele miejsc pracy, co może zwiększyć nierówności społeczne. Dlatego inwestowanie w edukację oraz przekwalifikowanie pracowników staje się konieczne.

Nowe możliwości zawodowe w erze SI

Choć sztuczna inteligencja zagraża niektórym zawodom, jednocześnie tworzy nowe możliwości zatrudnienia. Poniżej przedstawiam kilka obszarów, w których powstają nowe miejsca pracy:

- Inżynieria danych

- Zarządzanie systemami AI

- Rozwój innowacyjnych usług dostosowanych do potrzeb użytkowników

- Zawody związane z programowaniem i analizą danych

Pomimo istniejących zagrożeń, wdrożenie sztucznej inteligencji w sektorach, takich jak medycyna czy logistyka, przynosi wiele korzyści. Algorytmy SI umożliwiają szybszą analizę danych, co prowadzi do tańszej oraz bardziej efektywnej produkcji i usług. Przykłady skutecznych zastosowań obejmują personalizację leczenia i optymalizację łańcuchów dostaw.

Wyzwania związane z AI dotyczą również etyki oraz bezpieczeństwa. Pojawia się pytanie, kto odpowiada za błędy maszyn i jakie regulacje powinny obowiązywać. To wszystko ma na celu zapewnienie, że AI poprawi jakość życia, a nie będzie mu zagrażać.

Podsumowując, przyszłość pracy w kontekście sztucznej inteligencji przynosi zarówno wyzwania, jak i szanse. Przemyślana regulacja oraz inwestycje w edukację mogą przyczynić się do efektywnego wykorzystania AI. Kluczowe jest odpowiedzialne zarządzanie technologią, które przynosi korzyści całemu społeczeństwu. Musimy zrozumieć, jak wykorzystać potencjał sztucznej inteligencji, minimalizując jednocześnie jej związane zagrożenia.

Etyka w AI: Wyzwania moralne w kontekście sztucznej inteligencji

Sztuczna inteligencja (AI) to jedna z najbardziej rewolucyjnych technologii nowoczesności. Ta technologia ma ogromny potencjał, ale niesie także poważne wyzwania etyczne. Jakie zagrożenia związane są z nadużywaniem, stronniczością oraz odpowiedzialnością za decyzje podejmowane przez algorytmy?

Kluczowym dylematem etycznym w kontekście AI jest odpowiedzialność za szkody wyrządzone przez systemy oparte na sztucznej inteligencji. Kto powinien ponieść odpowiedzialność: producent, użytkownik czy programista? Brak jednoznacznych regulacji prawnych stwarza ryzyko braku motywacji do zapewnienia wysokiej jakości produktów oraz możliwości nadużyć.

Zagrożenia dla prywatności i demokracji

Sztuczna inteligencja wpływa na prywatność użytkowników. Analiza danych osobowych przez AI może prowadzić do ich niewłaściwego wykorzystania. Sytuacje takie jak inwigilacja za pomocą technologii rozpoznawania twarzy rodzą wiele pytań o granice prywatności. AI, wykorzystana do propagowania fałszywych informacji, destabilizuje demokratyczne procesy.

Drugim istotnym zagrożeniem związanym z rozwojem AI jest wpływ na rynek pracy. Automatyzacja procesów zwiększa efektywność, ale może eliminować tradycyjne miejsca pracy. Jest to szczególnie dotkliwe dla pracowników niskokwalifikowanych. Sztuczna inteligencja przekształca struktury zatrudnienia, dlatego istotne jest przemyślane podejście do edukacji i przekwalifikowania.

W związku z tym ogromnym wyzwaniem dla społeczeństw będzie dostosowanie regulacji dotyczących AI do zmieniającej się rzeczywistości. Stworzenie Frameworku etycznego, który będzie regulował rozwój i zastosowanie sztucznej inteligencji, staje się kluczowe.

W obliczu tych wyzwań, warto podkreślić znaczenie kształcenia społeczeństwa w zakresie sztucznej inteligencji. Wzrost świadomości na temat korzyści i zagrożeń związanych z AI jest kluczem do odpowiedzialnego korzystania z tej technologii. Jako ludzkość musimy spojrzeć na sztuczną inteligencję nie tylko jako narzędzie efektywności, ale także jako konstrukcję etyczną.

Innowacje technologiczne: Jak AI wspiera rozwój medycyny i nauki?

Sztuczna inteligencja (AI) to jedno z najbardziej dynamicznych narzędzi, które rewolucjonizuje medycynę i naukę. Jej zdolność do analizy dużych zbiorów danych sprawia, że AI może dostarczać precyzyjne diagnozy. Przykładowo, algorytmy AI identyfikują nowotwory na podstawie obrazów medycznych. Dzięki temu lekarze mogą szybciej podejmować decyzje o terapii.

Innowacje AI wspierają rozwój personalizowanej medycyny. Umożliwia to dostosowanie terapii do indywidualnych potrzeb pacjentów. Dzięki analizie genotypów i historii chorób, specjaliści mogą tworzyć skuteczniejsze plany leczenia.

Wykorzystanie AI w badaniach naukowych

W obszarze badań naukowych sztuczna inteligencja przyspiesza odkrywanie nowych leków. Algorytmy AI analizują wyniki badań klinicznych, identyfikując wzorce i formułując hipotezy. To zwiększa efektywność oraz obniża koszty prowadzonych badań. Dzięki AI, naukowcy szybciej testują hipotezy i wdrażają innowacje.

Jednak rosnące uzależnienie od AI niesie ze sobą pewne zagrożenia. Istnieje ryzyko, że algorytmy mogą być stronnicze, co prowadzi do dyskryminacji pacjentów. Ważne jest projektowanie technologii AI w sposób etyczny i zgodny z regulacjami.

Wśród zagrożeń związanych z wykorzystaniem AI w medycynie znajdują się:

- Stronniczość algorytmów, prowadząca do dyskryminacji pacjentów.

- Brak przejrzystości w procesie podejmowania decyzji przez AI.

- Możliwe naruszenie prywatności pacjentów.

Podsumowując, innowacje technologiczne wspierane przez sztuczną inteligencję mają potencjał, aby istotnie wpłynąć na rozwój medycyny i nauki. Kluczowe jest świadome podejście do tych technologii. Powinno ono towarzyszyć ich rozwojowi, aby technologia ta była narzędziem zwiększającym efektywność, a przede wszystkim bezpiecznym rozwiązaniem dla pacjentów i społeczności naukowej.

Zagrożenie dla prywatności: Jak AI monitoruje nasze życie codzienne?

Sztuczna inteligencja (AI) wchodzi w coraz więcej obszarów naszego codziennego życia. To zjawisko niesie zarówno obietnice, jak i poważne zagrożenia dla prywatności. Gdy AI staje się wszechobecna, monitoruje nasze codzienne zachowania. Analizuje dane osobowe, co budzi nasze wątpliwości. Algorytmy te, oparte na olbrzymich zbiorach informacji, służą do optymalizacji usług. Jednak równocześnie są wykorzystywane do profilowania użytkowników.

Wykorzystanie AI do analizy danych coraz mocniej ingeruje w nasze życie prywatne. Niemniej jednak, równocześnie zbierają informacje o naszych preferencjach, lokalizacji czy nawykach. To, co początkowo wydaje się nieszkodliwe, może prowadzić do poważnych problemów. Osoby trzecie mogą uzyskać dostęp do wrażliwych danych, co zagraża naszej prywatności i bezpieczeństwu.

Zagrożenia związane z dezinformacją i deepfake’ami

Jednym z najgroźniejszych aspektów AI jest generowanie fałszywych informacji. Choć narzędzie to może być używane w kreatywny sposób, w rękach złych aktorów staje się groźne. Takie manipulacje mogą zaszkodzić reputacji osób oraz zniekształcać rzeczywistość.

Bezpieczeństwo danych to kolejny ważny temat związany z AI. Systemy te działają na ogromnych zbiorach danych, a ich nieprzewidywalne zachowanie może skutkować wyciekiem informacji. Muszą one chronić użytkowników. W Unii Europejskiej trwają prace nad ustawodawstwem regulującym użycie AI. Celem jest zapewnienie ochrony prywatności oraz przestrzeganie zasad etyki.

Nie możemy zapominać o odpowiedzialności związanej z decyzjami podejmowanymi przez AI. Gdy algorytmy decydują o kredytach lub oskarżeniach, pojawia się ważne pytanie. Kto ponosi odpowiedzialność za te decyzje: projektant, programista czy użytkownik?

Podsumowując, sztuczna inteligencja przynosi znaczące korzyści, ale wprowadza też poważne zagrożenia dla naszej prywatności. Ważne jest, aby świadome korzystanie z tych technologii szło w parze z odpowiedzialnością oraz regulacjami. W ten sposób możemy zapewnić sobie bezpieczeństwo w świecie opanowanym przez AI.

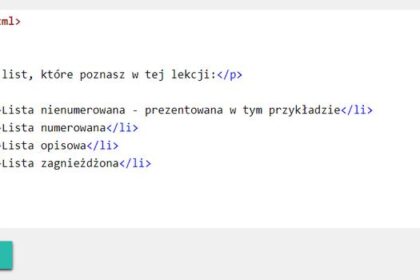

| Zagrożenie | Opis |

|---|---|

| Monitoring codziennego życia | Sztuczna inteligencja analizuje dane osobowe, co rodzi wątpliwości dotyczące prywatności. |

| Ingerencja w życie prywatne | Narzędzia AI zbierają informacje o preferencjach, lokalizacji i nawykach użytkowników. |

| Dostęp do wrażliwych danych | Osoby trzecie mogą uzyskać dostęp do danych, co zagraża prywatności i bezpieczeństwu. |

| Dezinformacja i deepfake | Technologia deepfake umożliwia tworzenie fałszywych informacji, co może zaszkodzić reputacji osób. |

| Bezpieczeństwo danych | Niekontrolowane zachowanie AI może prowadzić do wycieków informacji, co zwiększa potrzebę regulacji prawnych. |

| Odpowiedzialność za decyzje AI | Pojawia się pytanie, kto ponosi odpowiedzialność za decyzje podejmowane przez algorytmy. |

Ciekawostka: W 2021 roku zespół badawczy z Uniwersytetu Stanforda stworzył system AI zdolny do oceny prawdziwości treści internetowych. Dzięki analizie wzorców językowych oraz danych kontekstowych, technologia ta była w stanie identyfikować dezinformację z 90% skutecznością.

Podsumowanie

- Rozwój sztucznej inteligencji (SI) stwarza zarówno szanse, jak i zagrożenia, w tym kwestie ochrony prywatności.

- Użytkownicy powinni być ostrożni w przekazywaniu wrażliwych danych, a regulacje dotyczące SI są niezbędne dla ochrony przed nadużyciami.

- Efekt czarnej skrzynki i brak przejrzystości w decyzjach algorytmów zwiększają ryzyko dla użytkowników.

- Sztuczna inteligencja powoduje zmiany na rynku pracy, automatyzując wiele rutynowych zadań, co może prowadzić do bezrobocia technologicznego.

- Jednak SI także tworzy nowe miejsca pracy w obszarach takich jak inżynieria danych czy rozwój systemów AI.

- W obszarze medycyny, AI przyspiesza diagnozy i rozwój personalizowanej medycyny, ale wiąże się z zagrożeniami, m.in. stronniczością algorytmów.

- Bezpieczeństwo danych i możliwość dezinformacji, w tym generowanie fałszywych informacji, stanowią poważne wyzwania związane z SI.

- Konieczne jest odpowiedzialne podejście do regulacji oraz edukacji w zakresie SI, aby minimalizować zagrożenia i maksymalizować korzyści płynące z technologii.

Źródła:

- https://www.europarl.europa.eu/topics/pl/article/20200918STO87404/sztuczna-inteligencja-szanse-i-zagrozenia

- https://oclab.pl/zalety-i-wady-sztucznej-inteligencji/

- https://delkom.pl/blog-wpis/sztuczna-inteligencja-pozytywne-i-negatywne-aspekty-211

- https://www.gov.pl/web/baza-wiedzy/pulapki-zwiazane-z-wykorzystywaniem-sztucznej-inteligencji–jak-unikac-zagrozen

- https://gsu.pl/sztuczna-inteligencja-zagrozenie-czy-szansa-dla-czlowieka/

- https://www.ey.com/pl_pl/insights/cybersecurity/sztuczna-inteligencja-ryzyka

- https://webdesign25h.pl/sztuczna-inteligencja-co-kazdy-powinien-wiedziec-podstawy-korzysci-i-zagrozenia